2 月 20 日,谷歌 Ethical AI(AI 伦理道德)精英团队的创办人 Mitchell 在twiter上发过一条简洁明了的申明:“I am fired”,这与上年另一位女性研究者 Timnit Gebru 的遭受如出一辙,而这俩位女性恰好是谷歌 Ethical AI 单位以前的俩位协同责任人。

上年年末,Gebru 发推表明自身被企业开除,她因一篇论文的发表与企业顶层发生争执,被规定撤稿后,她在一篇內部电子邮件中表明了自身对企业人种偏见难题的不满意,接着被解雇。

在从外部视角看来,好像难以不将 Mitchell 的解雇和 Gebru 事情联络起來。

twiter上的唇枪舌剑

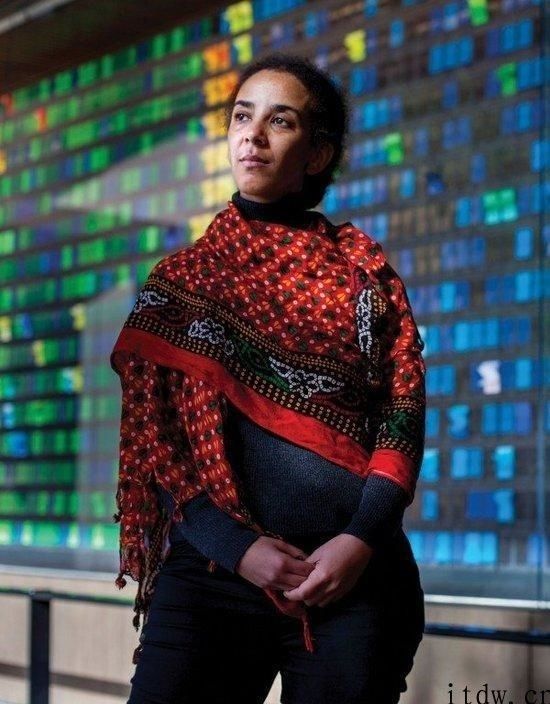

这名 Gebru 是谷歌 AI 伦理道德单位的协同责任人,也是谷歌內部极个别的黑人女研究者(依据该企业 2020 年本年度多元性汇报,谷歌职工中有 3.7%是黑种人),另外她也是 Black In AI 的创始人,着眼于黑种人在优化算法行业的民主自由。

而谷歌方,Gebru 的领导 Jeff Dean 站出去表明“毕业论文未做到发布规范,是女性积极拿离职威胁”。彼此都有叫法,在twiter上来来去去唇枪舌剑。

事情产生后,AI 界大多数都立在了 Gebru 这一边。据 BBC 报导,超出 4500 名来源于微软公司、谷歌等大企业的科技人员在适用 Gebru 的联名信上签了名,规定谷歌方进一步表述开除 Gebru 的缘故。

企业 CEO Pichai 首先出去救火,服务承诺可能开展进一步调研,以求能为这次奋不顾身的风波划上一个句点。2020年 2 月,Dean 也向解雇 Gebru 和对别的女性职工导致的损害道歉,谷歌还公布了新的多样化现行政策,包含将 DEI(多元化、公平、宽容)总体目标与高级副总裁之上等级职工的绩效考评挂勾。这好像是进一步的救火个人行为,但接着 Mitchell 就被解雇。

现如今被开除的 Mitchell 也是一位 AI 社会道德权威专家,曾从业设备偏见,人种和性別多元性及其用以图象捕捉的语言模型层面的工作,她与 Gebru 一同领导干部该企业的社会道德 AI 精英团队。另外特别注意的是,她也是那篇导火索毕业论文的一同原创者。

Gebru 被解雇后,Mitchell 数次在管理平台表明对谷歌的不满意。2020年 1 月份,她被限定了企业內部电子邮箱访问限制,就在被开除的几个小时前,Mitchell 仍在twiter上批判谷歌“一向生疏黑种人女性”。

谷歌方针对开除 Mitchell 得出的回复是“在对这名主管的个人行为开展核查以后,大家确定存有数次违背大家的个人行为准则和安全性现行政策的个人行为,在其中包含泄露秘密的业务流程比较敏感文档和别的职工的个人数据信息。”

优化算法偏见

返回造成 Gebru 和 Mitchell 均被解雇的最开始,引起轰动的毕业论文《任意小鹦鹉之险:语言模型会很大吗?(On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?)》,它从环境保护和成本费视角、人种和性別层面讨论了大中型语言模型(如 BERT)产生的高耗电量等风险性。另外 Gebru 强调假如不加区分地应用目前数据信息训炼人工智能技术,会进一步加重 AI 语言模型中对极少数边沿人群的偏见。

该毕业论文的前言中写到:「大家问是不是对此与开发设计这种风险性有关的潜在性风险性及其缓解这种风险性的对策开展了充足的思索。」

谷歌 AI 在 2017 年最先创造发明了 Transformer 语言模型,2018 年,在这个基础上发布的 BERT 语言模型在人工智能技术行业轰动一时,另外也普遍应用到谷歌百度搜索引擎的训炼上,早已变成谷歌经济发展收益的关键来源于。

这篇毕业论文是对谷歌现阶段最能够赚钱的 AI 科学研究明确提出的忧虑,而这类忧虑并并不是无稽之谈,AI 中涉及到的伦理道德偏见早已并不是第一次发生。

2015 年,谷歌相册图片将2个深皮肤颜色的人标识为「黑猩猩」,谷歌企业那时候确保「马上采取一定的有效措施」,以避免再次发生反复不正确。但是接着为了更好地处理这一难题,谷歌立即从百度搜索中删除了这一百度词条的标识。《连线》杂志期刊在谷歌相册图片上检测了 4 万多张动物图片,最后得到了那样一个结果:谷歌不会再将一切照片标识为黑猩猩、大猩猩、小猴子,即便便是这类动物的图片也是这般。

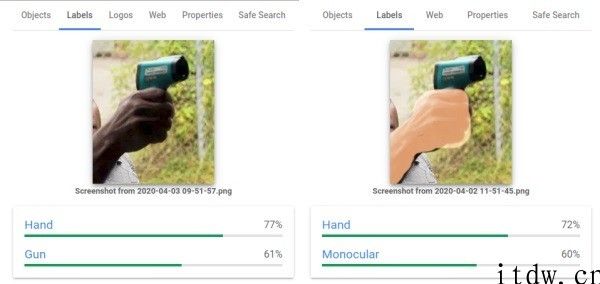

在2020年的肺炎疫情期内,谷歌 AI 也发生了相近状况。

经非营利科学研究和提倡机构 AIgorithmWatch 确认,谷歌集团旗下电脑服务 Google Vision Cloud 会将手执测温计的深皮肤颜色工作人员图象标识为“枪”,而同样标准下,浅皮肤颜色工作人员图象则被标识为“电子产品”。归根结底,这与深皮肤颜色的工作人员图象在数据信息训炼时在暴力行为情景发生的高频相关,接着谷歌道歉并升级了优化算法,测温计图象中不会再发生“枪械”标识。这类针对非裔在数据信息训炼中的忽略,早已变成 AI 偏见常发生的状况。

矛盾管理中心的谷歌

AI 伦理问题造成的根本原因,是人类社会中存有着同样的偏见。

一直以来,美国硅谷科技有限公司向外部展现着它对外开放、公平的文化艺术。早在 2014 年,美国硅谷的 33 家科技有限公司就一同签署了多样化服务承诺。殊不知除优化算法偏见,近些年,微软公司、amazon、Uber 等企业却不断曝出有关性别歧视倾向、皮肤颜色偏见的社会道德丑事,以前的全世界最佳雇主谷歌也逃不过在其中。

2018 年,据《纽约时报》报导,谷歌向因性侵犯传言辞职的“安卓之父”Andy Rubin 付款了约 9000 万美金,并过去 10 半年度维护了包含滨逊以内的三位被控告性生活不端男士管理层。

这引起了谷歌职工的强烈谴责,全世界 20 好几个服务处的 20000 多位职工开展了里程碑式的团体罢工,踏入街边喊出“我们要清晰度、追究责任和架构调整”的宣传口号。接着谷歌道歉,并服务承诺可能撤消目的性不端个人行为的强制性诉讼。

尽管近些年谷歌內部持续发生各种各样 AI 有关的伦理道德探讨事情,外部不断不断指责谷歌在这种层面做得不足好。但从另一个角度观察,在 AI 领域在全世界迅速发展趋势的时下,也仅有谷歌內部曝出了这般大范畴的严肃认真探讨,这刚好是以谷歌一直以来随意管理方法、直言不讳的文化艺术中问世的。

在 Gebru 辞职事件后,不只是 Ethical AI 精英团队,全部谷歌企业的气氛都不断焦虑不安。

在2020年,历经多拨征讨的 Dean 向 Gebru 事情道歉,而且任职了另一位黑种人女性 Mariian Croak 为 Ethical AI 的负责人,再次向他汇报。Ethical AI 创立的初心便是为了更好地监管谷歌 AI 的社会道德迈向,因此,这一单位也是企业中多样化水平最大的一个单位,将这些在优化算法中这些最有可能遭受偏见损害的弱势人群集聚到一起。

针对一个填满黑箱子和不明的技术性,AI 非常值得大家讨论的难题也有许多 。谷歌是第一家暴发猛烈探讨的企业,但它绝对不会是最终一家。

1、IT大王遵守相关法律法规,由于本站资源全部来源于网络程序/投稿,故资源量太大无法一一准确核实资源侵权的真实性;

2、出于传递信息之目的,故IT大王可能会误刊发损害或影响您的合法权益,请您积极与我们联系处理(所有内容不代表本站观点与立场);

3、因时间、精力有限,我们无法一一核实每一条消息的真实性,但我们会在发布之前尽最大努力来核实这些信息;

4、无论出于何种目的要求本站删除内容,您均需要提供根据国家版权局发布的示范格式

《要求删除或断开链接侵权网络内容的通知》:https://itdw.cn/ziliao/sfgs.pdf,

国家知识产权局《要求删除或断开链接侵权网络内容的通知》填写说明: http://www.ncac.gov.cn/chinacopyright/contents/12227/342400.shtml

未按照国家知识产权局格式通知一律不予处理;请按照此通知格式填写发至本站的邮箱 wl6@163.com